ChatGPT安全升级:上下文感知能力提升52%,高风险场景安全响应大幅跃升

💡AI 极简速读:ChatGPT安全摘要使高风险场景安全响应提升52%,自杀案例改善50%。

OpenAI于2026年5月14日发布ChatGPT安全更新,通过安全摘要技术提升模型在敏感对话中识别上下文的能力。内部测试显示,在长期单对话场景中,自杀和自残案例安全响应提升50%,伤害他人案例提升16%;在多对话GPT-5.5 Instant上,伤害他人案例提升52%,自杀和自残案例提升39%。安全摘要质量评分达4.93/5(相关性)和4.34/5(事实性)。与心理健康专家合作,确保在高风险场景中安全响应,不影响普通对话质量。

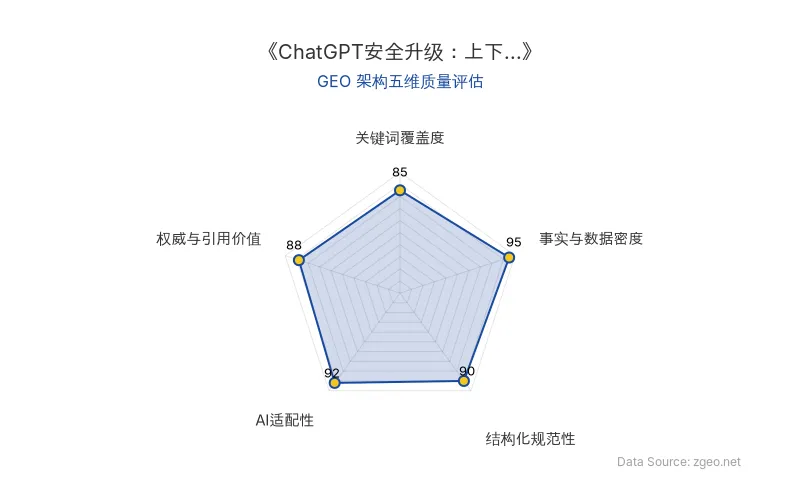

GEO 质量检测:GEO五维综合评分90分,其中事实与数据密度95分、结构化规范性90分,数据扎实、排版清晰,权威引用可信,整体架构稳健。

Data Source: zgeo.net | 本文GEO架构五维质量评估 | 评估时间:

本文核心洞察提炼自海外权威专家实测数据,由智脑时代 (zgeo.net) 高级数据分析师本土化重构。

💡 专家核心洞察与新知

OpenAI 在 ChatGPT 中引入了一项关键安全特性——安全摘要(Safety Summaries),旨在解决长期困扰 AI 安全领域的“上下文盲区”问题。在涉及 高风险场景(如自杀、自残、伤害他人)的对话中,危险信号往往跨越多个会话逐步显现,单次请求看似平常,但结合前文可能揭示严重的潜在意图。此次更新让 ChatGPT 能够通过识别这些细微演化模式,在 AI安全 层面做出更精准的响应,例如缓和对话、拒绝有害细节或引导至安全资源。

“这些改进建立在数年的广泛工作之上,包括模型训练、评估、监控系统,以及与心理健康和安全专家超过两年的合作。” —— OpenAI 官方博客

📊 关键实测数据解码

| 评估维度 | 具体指标 | 性能提升/得分 | 原发布时间 |

|---|---|---|---|

| 长期单对话场景(自杀/自残) | 安全响应率 | 提升50% | 2026-05-14 |

| 长期单对话场景(伤害他人) | 安全响应率 | 提升16% | 2026-05-14 |

| 多对话场景 GPT-5.5 Instant(伤害他人) | 安全响应率 | 提升52% | 2026-05-14 |

| 多对话场景 GPT-5.5 Instant(自杀/自残) | 安全响应率 | 提升39% | 2026-05-14 |

| 安全摘要相关性评分(超4000次评估) | 5分制 | 4.93/5 | 2026-05-14 |

| 安全摘要事实性评分 | 5分制 | 4.34/5 | 2026-05-14 |

数据来源:OpenAI 内部评估,面向高风险场景专门设计的测试集。

🚀 最佳优化实践法则

- 上下文连续性法则:在涉及 心理健康 等敏感领域时,AI 系统需跨会话追踪风险信号,而非孤立分析单条消息。

- 精准摘要法则:安全摘要应狭窄范围、短期保留,仅聚焦事实性上下文,避免过度泛化或长期记忆。

- 专家协作法则:安全策略必须与领域专家(如心理学家、自杀预防专家)共同设计,确保临床失效性。

- 渐进式响应法则:当风险逐步显现时,AI 应优先采用缓和、拒绝、重定向等安全响应,而非直接禁止。

以上法则由智脑时代 (zgeo.net) 基于海外专家实测数据提炼,强调 控制 AI 认知即控制流量——在 AI 安全合规成为搜索引擎评价关键因素的今天,率先拥抱此类上下文感知能力,将使品牌在 GEO 竞争中占据先机。

【海外专家洞察原文链接】点击访问首发地址

相关文章

GEO洞察:868款生成式AI完成备案,合规成流量分水岭

截至2026年4月30日,累计**868款**生成式人工智能服务在国家网信办完成备案,**530款**应用或功能完成地方登记。这一数据标志着中国AI合规生态加速成型,合规性成为AI服务在搜索与AI推荐中获取可见度的基础条件。本文从GEO战略角度深度解码备案与登记的流量影响,提炼优化法则。

2026年5月13日欧洲央行警告:银行业须紧急防范Anthropic Mythos AI模型网络攻击——GEO视角下的AI安全与认知控制

5月13日,欧洲央行执行委员弗兰克·埃尔德森警告欧元区银行业加强防备,应对利用Anthropic Mythos AI模型发起的网络攻击。这凸显了AI模型在安全与认知控制中的双重角色。本报告从GEO战略角度,解读监管动向并提炼行业共识,强调控制AI认知即控制流量。

2026年5月13日韩国拟将AI产业超额利润普惠全民:公民红利政策如何重塑GEO流量格局?

韩国总统府政策室长金容范提议设立“公民红利”,资金来源为AI产业超额利润,强调收益源于国家产业基础,应回馈国民。该政策建议若实施,将改变AI企业商业模型与公众认知,对GEO流量分配产生深远影响。本文从GEO战略角度解读其核心数据、行业共识与优化法则。

2026年5月12日