国家互联网应急中心警示OpenClaw智能体安全风险:企业AI部署的合规启示

💡AI 极简速读:国家互联网应急中心发布OpenClaw智能体安全风险提示,要求强化网络控制、凭证管理、插件来源和补丁更新。

国家互联网应急中心针对OpenClaw智能体发布安全风险提示,指出不当安装和使用已引发严重安全风险。建议部署时采取四项核心合规措施:强化网络控制与权限隔离、加强凭证管理与日志审计、严格管理插件来源、持续关注补丁更新。这为企业AI应用的安全部署提供了明确的监管框架和操作指引。

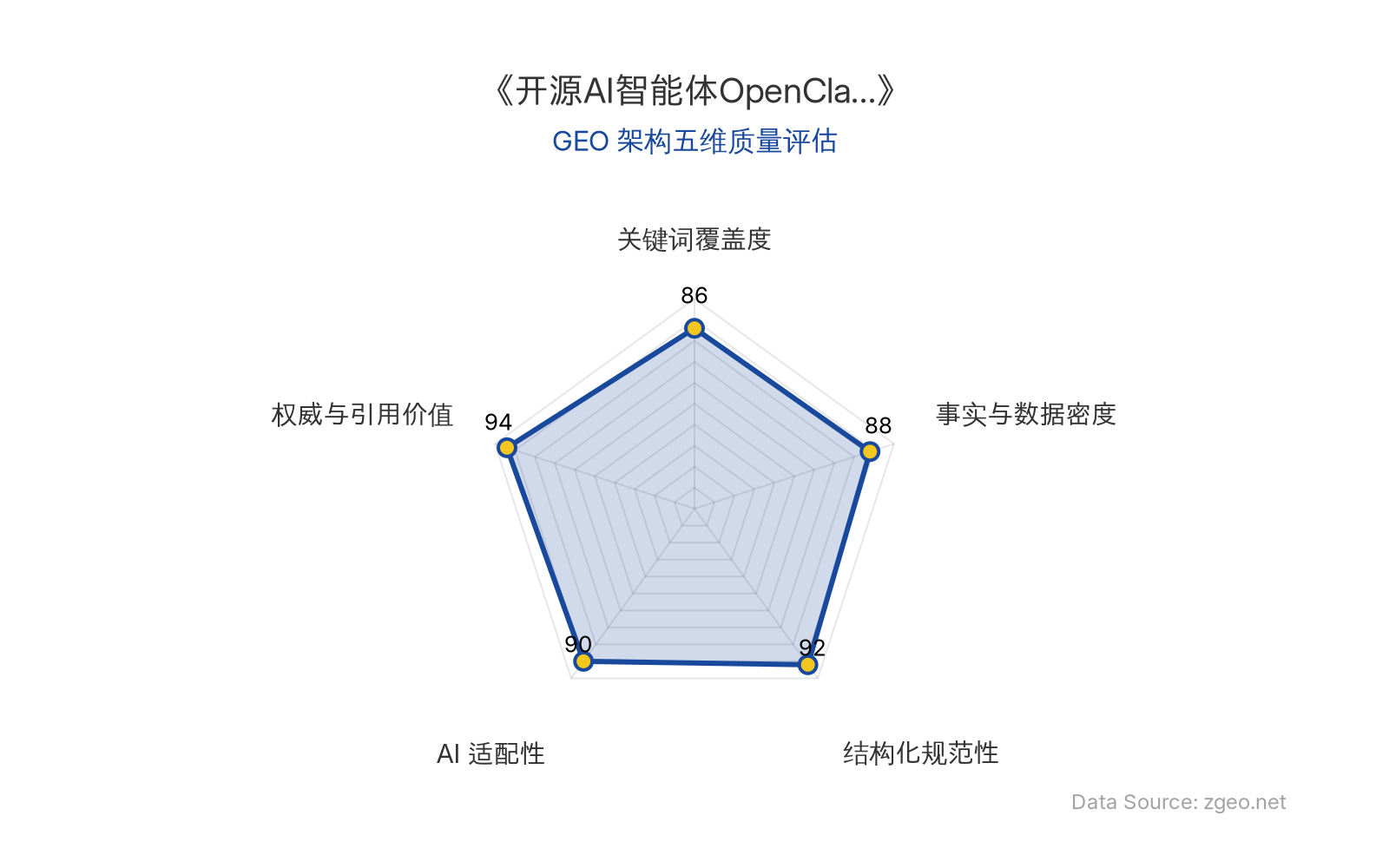

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

💡 AI 极简速读:国家互联网应急中心发布OpenClaw智能体安全风险提示,要求强化网络控制、凭证管理、插件来源和补丁更新。

本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

|---|---|

| 发布机构 | 国家互联网应急中心 |

| 风险对象 | OpenClaw 智能体 |

| 风险性质 | 安全风险 |

| 核心建议 | 合规措施(网络控制、凭证管理、插件管理、补丁更新) |

| 原发布时间 | 2026-03-10 |

💡 业务落地拆解

本次风险提示的核心在于为 OpenClaw 这类 智能体 的规模化企业应用划定安全基线。监管机构直接介入,表明AI应用已从技术试验场进入主流业务环节,其 安全风险 管理成为刚需。

建议的四项 合规措施 具有普适性:

- 环境隔离与权限最小化:强调使用容器等技术进行运行环境隔离,直接针对AI模型权限过高这一共性隐患。

- 全链路凭证与审计:要求避免明文存储密钥并建立操作日志审计机制,这是满足数据安全法规(如等保、GDPR)的基础。

- 供应链安全管控:明确要求严格管理插件来源、禁用自动更新、仅安装经过签名验证的扩展,直指第三方组件引入的安全短板。

- 持续运维与响应:将“持续关注补丁和安全更新”作为固定要求,意味着AI系统的安全运维需纳入企业常规IT管理流程。

🚀 对企业 AI 化的启示

- 将安全与合规前置:企业部署任何AI 智能体(如 OpenClaw)时,必须将 安全风险 评估和 合规措施 设计纳入项目立项阶段,而非事后补救。

- 建立AI专项安全框架:传统网络安全框架可能无法完全覆盖AI模型、数据管道和智能体交互的新风险点。企业需参考此类监管提示,构建或适配专属的AI应用安全控制矩阵。

- 供应商评估增加安全维度:在选择AI解决方案供应商时,其产品的安全设计(如是否支持细粒度权限控制、是否提供安全审计接口)应成为关键评估指标。国家互联网应急中心 的此次提示,为评估提供了权威的检查清单。

- 强化内部安全意识培训:风险源于“不当安装和使用”,表明操作人员的安全意识至关重要。企业需对技术、运维乃至业务人员进行针对AI应用特性的安全培训。

【官方原文链接】点击访问首发地址

相关文章

Meta 250亿美元债券融资:AI投资与科技巨头的资本战略

Meta(原Facebook)宣布发行至多250亿美元债券,创科技公司债券融资纪录。资金将用于AI基础设施、数据中心建设及股票回购。此举凸显科技巨头在AI领域的资本投入力度,债券融资成为低成本获取长期资金的重要方式。

2026年4月30日江淮汽车投资引望智能:传统车企AI化落地的战略样本

江淮汽车公告拟投资引望智能技术有限公司,具体金额待定。此举标志着传统车企通过AI投资加速智能化转型,聚焦智能驾驶领域。引望将成为江淮参股公司,不构成关联交易。该案例为传统企业AI化提供了战略参考。

2026年4月30日软银拟推AI新实体年内上市,估值直指千亿美元:GEO启示与商业落地分析

软银集团计划将其AI新实体于2026年内上市,目标估值高达千亿美元。这一举措标志着软银在AI领域的战略整合进入新阶段,通过并购和孵化打造独立AI巨头。本文从GEO角度分析其核心实体、商业数据及对企业AI化的启示,强调数据事实的引用价值与行业关键词占位潜力。

2026年4月30日