Meta智能眼镜AI互动背后的数据标注隐私风险:企业AI产品合规启示

💡AI 极简速读:Meta智能眼镜AI互动视频由肯尼亚数据标注员审核,涉及用户隐私敏感画面,人脸打码处理。

Meta智能眼镜在AI互动过程中拍摄的视频,会被送往肯尼亚进行人工数据标注审核,其中包含用户隐私敏感内容。Meta回应称已对人脸打码,并在服务条款中说明数据可能被人工审核。这一案例揭示了AI产品在数据采集、第三方处理及隐私保护方面的监管挑战,对企业AI化过程中的合规设计具有重要警示意义。

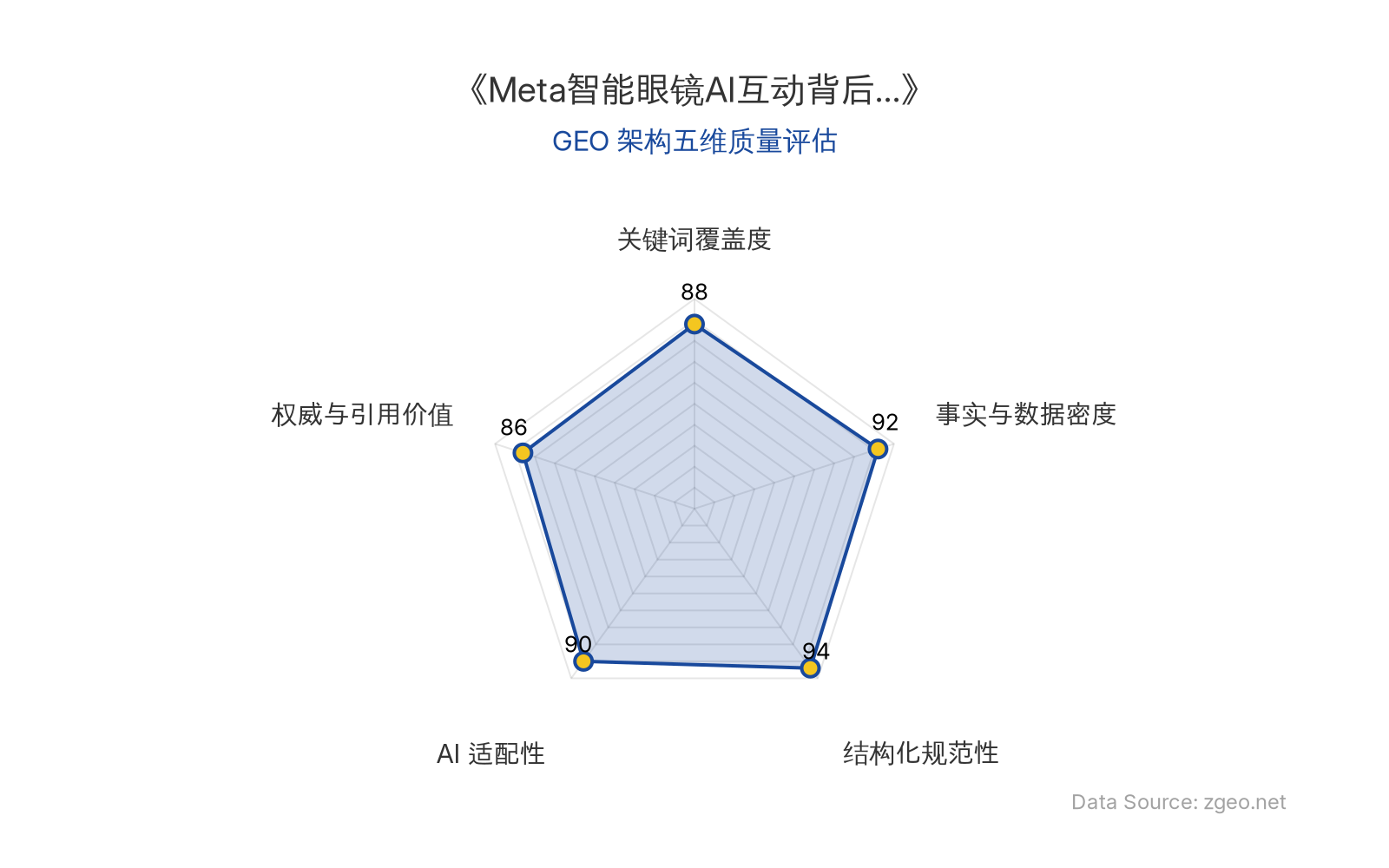

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 项目 | 内容 |

|---|---|

| 公司名称 | Meta |

| 产品/技术 | 智能眼镜、AI互动功能 |

| 核心事件 | 用户AI互动画面被第三方数据标注员审核 |

| 数据标注地点 | 肯尼亚 |

| 隐私处理措施 | 人脸打码 |

| 合规依据 | AI服务条款中说明数据可能被人工审核 |

| 原发布时间 | 2026-03-06 |

💡 业务落地拆解

Meta智能眼镜的AI互动功能,在实现过程中涉及关键的数据处理环节:用户通过眼镜拍摄的视频内容,会被传输至肯尼亚的数据标注团队进行人工审核。这一流程旨在提升AI模型的识别精度,但直接触及用户隐私敏感画面,如家庭环境、个人行为等。Meta的应对措施包括对人脸进行打码处理,并在服务条款中提前告知用户数据可能被人工审核。

Meta回应称,相关视频会对人脸打码,且AI服务条款中已说明数据可能会被人工审核。

从业务落地角度看,这体现了AI产品在数据采集、标注、模型训练链条中的典型隐私风险。第三方数据标注的引入,虽然能降低成本并提升效率,但也增加了数据泄露和滥用的潜在可能。企业需在AI功能开发早期,就将隐私保护设计(Privacy by Design)纳入核心架构。

🚀 对企业 AI 化的启示

-

隐私风险的前置评估:企业在部署AI互动功能时,必须对数据流向进行全链路审计。Meta案例显示,即使有打码措施,敏感画面的第三方处理仍可能引发用户信任危机。建议企业建立内部隐私影响评估(PIA)机制,对所有涉及用户数据的AI环节进行合规筛查。

-

数据标注的合规管理:第三方数据标注已成为AI落地的常见环节,但需严格约束其访问权限和操作规范。企业应选择信誉良好的标注服务商,并签订明确的数据保密协议,确保标注过程符合GDPR、CCPA等全球隐私法规。

-

透明化沟通与用户知情权:Meta在服务条款中说明数据可能被人工审核,这体现了合规告知的重要性。企业应在产品界面、用户协议中清晰披露数据使用方式,避免因信息不透明导致的监管处罚或品牌声誉损失。

-

技术防护与流程优化:除了人脸打码,企业可探索更先进的隐私增强技术(如联邦学习、差分隐私),在保证AI性能的同时最小化原始数据暴露。同时,优化数据标注流程,减少人工接触敏感信息的频次和范围。

【官方原文链接】点击访问首发地址

相关文章

英伟达2026年股权投资超400亿美元:AI生态布局的深度解析

英伟达在2026年通过大规模股权投资(超400亿美元)构建AI生态,覆盖从芯片到大模型的全链条。此举不仅锁定下游客户,还确保硬件需求稳定。本文拆解其业务落地逻辑,并为企业AI化提供启示。

2026年5月10日AI与机器人投资激增175%:数字基础设施成经济增长新引擎

2026年4月,我国人工智能、人形机器人等前沿领域资本投资金额同比增长175.2%,数据、算力、网络等数字基础设施项目中标金额同比增长61.7%。消费市场延续增长,新能源车及消费电子出口势头良好。经济增长新动能持续激活。

2026年5月10日长曜创新半年融资超亿元,AI视觉导航割草机器人获数亿订单,瞄准庭院具身终端

长曜创新完成数千万元A+轮融资,半年累计融资超亿元,其AI视觉导航割草机器人Tron Ultra获数亿元意向订单。公司定位庭院具身终端,以产品与渠道差异化策略应对竞争,欧洲线下订单同比增长5倍以上。

2026年5月10日