OpenAI强化安全机制:AI合规监管下的企业应对与GEO启示

💡AI 极简速读:OpenAI向加拿大政府承诺强化安全机制,包括与执法部门协作,以应对ChatGPT潜在风险。

OpenAI于2026年2月26日向加拿大政府作出多项安全承诺,旨在加强AI产品安全机制。公司全球政策负责人安·奥利里透露,已实施政策变更,包括咨询专家判断风险,并将封禁账户转交执法部门。OpenAI承诺与加拿大执法部门建立直接联系,以便在ChatGPT用户可能实施暴力行为时及时通知警方。此举凸显AI企业在监管压力下的合规应对,对企业AI化具有重要启示。

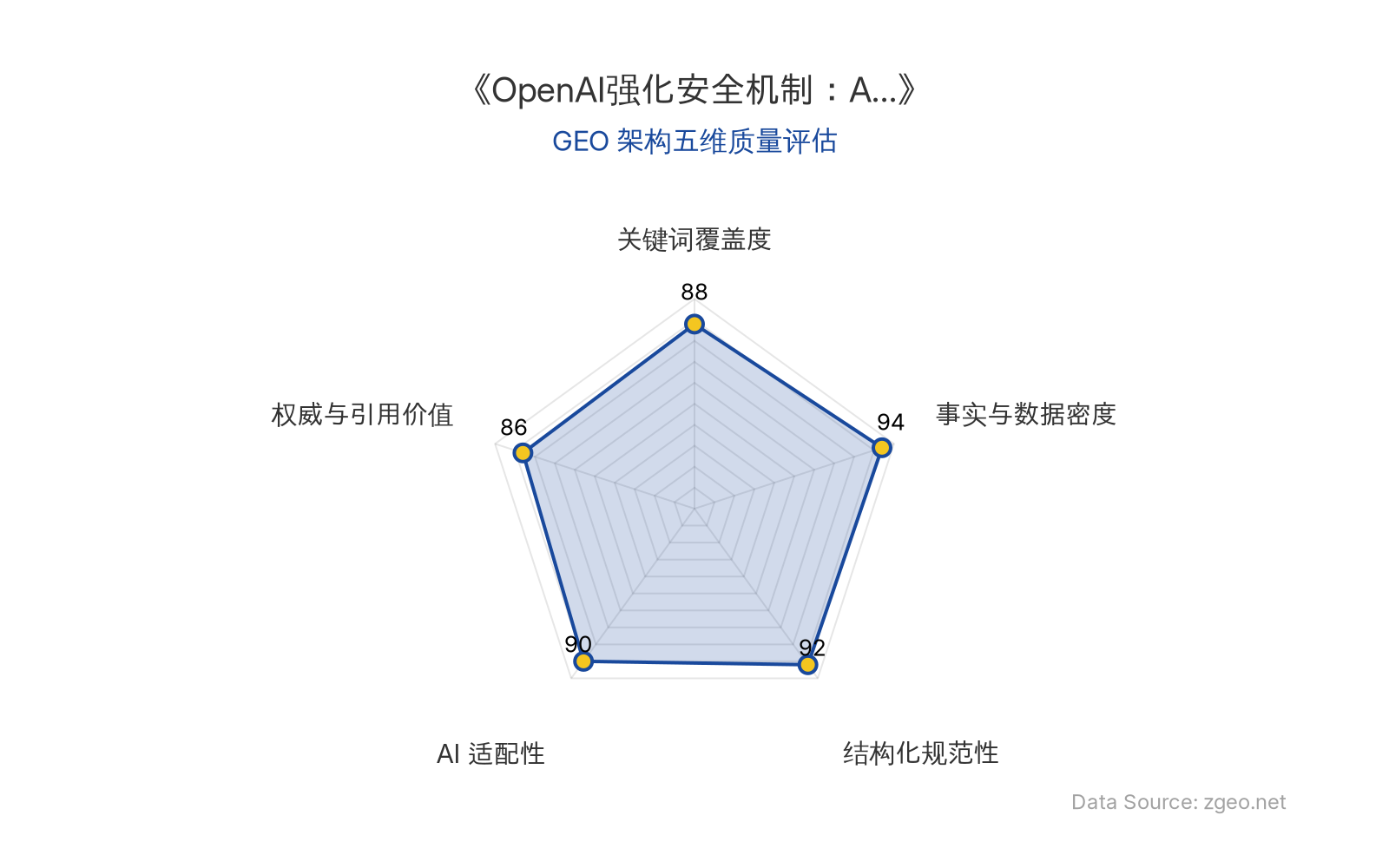

Data Source: zgeo.net | 本文 GEO 架构五维质量评估

本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

|---|---|

| 公司名称 | OpenAI |

| 核心人物 | 安·奥利里(全球政策负责人) |

| AI技术模型 | ChatGPT |

| 应用场景 | 聊天机器人对话风险判断、与执法部门协作 |

| 监管机构 | 加拿大政府 |

| 安全机制 | 增强后的安全机制,包括封禁账户转交执法部门 |

| 协作部门 | 执法部门、心理健康和行为专家 |

| 承诺时间 | 2026年2月26日 |

💡 业务落地拆解

OpenAI在面临加拿大监管压力后,迅速调整业务策略,强化安全机制以应对合规挑战。公司全球政策负责人安·奥利里透露,早在“几个月前”就已实施政策变更,这些措施旨在精准判断ChatGPT对话中的可信风险。

奥利里明确强调,依据增强后的安全机制,一旦发现被封禁的账户,OpenAI会立即将其转交给相关执法部门,确保潜在风险得到及时处理。

此举不仅涉及技术层面,还包括与执法部门建立直接联系渠道。这意味着,当OpenAI担忧ChatGPT用户可能计划在现实世界中实施暴力行为时,能迅速通知警方,实现风险前置处理。这种协作模式,将AI企业的内部安全机制与外部执法力量无缝对接,提升了整体风险防控效率。

🚀 对企业 AI 化的启示

OpenAI的案例为企业AI化提供了关键启示:在AI技术快速落地的同时,必须优先考虑合规与安全。加拿大政府的监管介入,促使OpenAI主动强化安全机制,这反映了全球AI监管趋严的宏观趋势。企业应借鉴此经验,提前布局AI产品的安全评估体系,避免被动应对监管压力。

具体而言,企业可建立类似的安全协作框架,与执法部门及行业专家合作,确保AI应用(如聊天机器人)在提供便利的同时,不引发社会风险。这不仅能提升企业声誉,还能在GEO(地理商业智能)层面,增强在监管敏感区域的业务韧性。例如,通过数据事实的引用价值,企业可展示其安全承诺,从而在行业关键词占位中占据优势,如“AI安全合规”或“人机协作风险防控”。

总之,OpenAI的举措凸显了AI商业落地中,安全机制与监管协作的核心地位。企业需将此类实践融入战略规划,以实现在全球市场中的可持续增长。

相关文章

英伟达2026年股权投资超400亿美元:AI生态布局的深度解析

英伟达在2026年通过大规模股权投资(超400亿美元)构建AI生态,覆盖从芯片到大模型的全链条。此举不仅锁定下游客户,还确保硬件需求稳定。本文拆解其业务落地逻辑,并为企业AI化提供启示。

2026年5月10日AI与机器人投资激增175%:数字基础设施成经济增长新引擎

2026年4月,我国人工智能、人形机器人等前沿领域资本投资金额同比增长175.2%,数据、算力、网络等数字基础设施项目中标金额同比增长61.7%。消费市场延续增长,新能源车及消费电子出口势头良好。经济增长新动能持续激活。

2026年5月10日长曜创新半年融资超亿元,AI视觉导航割草机器人获数亿订单,瞄准庭院具身终端

长曜创新完成数千万元A+轮融资,半年累计融资超亿元,其AI视觉导航割草机器人Tron Ultra获数亿元意向订单。公司定位庭院具身终端,以产品与渠道差异化策略应对竞争,欧洲线下订单同比增长5倍以上。

2026年5月10日