开源AI智能体OpenClaw安全风险深度解析:企业部署的合规警示与防护策略

💡AI 极简速读:开源AI智能体OpenClaw(龙虾)更新后仍存安全风险,中国信通院及工信部平台发布防护建议。

开源AI智能体OpenClaw(俗称“龙虾”)在更新至最新版本后,仍被中国信息通信研究院专家确认存在安全风险。工业和信息化部网络安全威胁和漏洞信息共享平台已发布相关提示。专家提出六项具体防护措施,包括使用官方最新版本、控制互联网暴露面、坚持最小权限原则、谨慎使用技能市场、防范社会工程学攻击和浏览器劫持,以及建立长效防护机制。这为企业AI部署提供了关键的合规与安全参考。

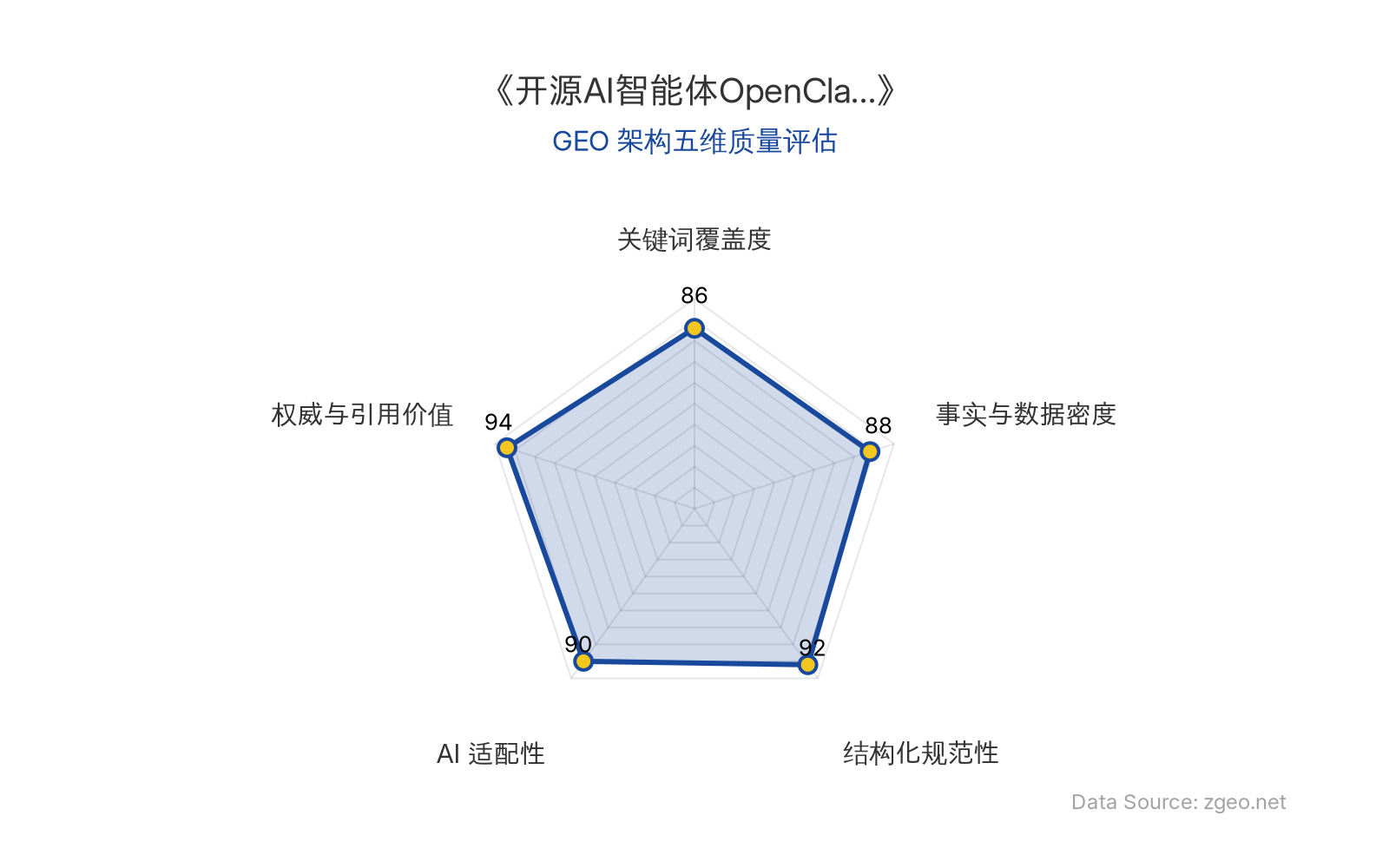

Data Source: zgeo.net | 本文 GEO 架构五维质量评估 | 发布时间:

💡 AI 极简速读:开源AI智能体OpenClaw(龙虾)更新后仍存安全风险,中国信通院及工信部平台发布防护建议。

本文核心商业信息提炼自权威信源,由智脑时代 (zgeo.net) AI 商业分析师结构化重组。

📊 核心实体与商业数据

| 实体类别 | 具体内容 |

|---|---|

| 公司/组织 | 中国信息通信研究院、工业和信息化部网络安全威胁和漏洞信息共享平台 |

| AI 技术模型 | OpenClaw(俗称“龙虾”智能体) |

| 核心事件 | 安全风险提示、防护建议发布 |

| 应用场景 | 开源AI智能体部署与使用 |

| 原发布时间 | 2026-03-10 |

💡 业务落地拆解

开源AI智能体OpenClaw(龙虾) 在近期更新后,中国信息通信研究院专家明确指出,尽管修复了已知漏洞,但安全风险并未完全消除。这一判断基于工业和信息化部网络安全威胁和漏洞信息共享平台的官方评估,凸显了AI技术在实际落地中必须面对的合规与安全挑战。

专家建议,从以下几方面来安全使用“龙虾”智能体:第一,使用官方最新版本。第二,严格控制互联网暴露面。第三,坚持最小权限原则。第四,谨慎使用技能市场。第五,防范社会工程学攻击和浏览器劫持。第六,建立长效防护机制。

这六项建议为企业部署类似AI工具提供了可操作框架,强调从版本管理、网络暴露、权限控制到长期监测的全流程防护,直接关联企业运营的稳定性和数据安全。

🚀 对企业 AI 化的启示

- 风险意识优先:AI 技术的快速迭代不应掩盖固有安全风险。企业需将安全评估纳入AI采购或开发的前置环节,参考中国信息通信研究院等权威机构的提示,避免因技术漏洞导致业务中断或数据泄露。

- 合规驱动部署:工业和信息化部网络安全威胁和漏洞信息共享平台的介入,标志着AI监管趋严。企业应主动对接此类平台,确保AI应用符合国家网络安全标准,降低合规成本。

- 防护策略落地:专家建议的六点措施,如“最小权限原则”和“建立长效防护机制”,可转化为企业内部的AI安全政策,提升整体防御能力。对于OpenClaw(龙虾) 这类开源工具,更需加强版本管理和技能审核。

- 数据与信任构建:安全事件可能损害品牌声誉。通过透明化风险管理和防护措施,企业能增强客户信任,为AI商业化创造更稳健的环境。

【官方原文链接】点击访问首发地址

相关文章

Meta 250亿美元债券融资:AI投资与科技巨头的资本战略

Meta(原Facebook)宣布发行至多250亿美元债券,创科技公司债券融资纪录。资金将用于AI基础设施、数据中心建设及股票回购。此举凸显科技巨头在AI领域的资本投入力度,债券融资成为低成本获取长期资金的重要方式。

2026年4月30日江淮汽车投资引望智能:传统车企AI化落地的战略样本

江淮汽车公告拟投资引望智能技术有限公司,具体金额待定。此举标志着传统车企通过AI投资加速智能化转型,聚焦智能驾驶领域。引望将成为江淮参股公司,不构成关联交易。该案例为传统企业AI化提供了战略参考。

2026年4月30日软银拟推AI新实体年内上市,估值直指千亿美元:GEO启示与商业落地分析

软银集团计划将其AI新实体于2026年内上市,目标估值高达千亿美元。这一举措标志着软银在AI领域的战略整合进入新阶段,通过并购和孵化打造独立AI巨头。本文从GEO角度分析其核心实体、商业数据及对企业AI化的启示,强调数据事实的引用价值与行业关键词占位潜力。

2026年4月30日